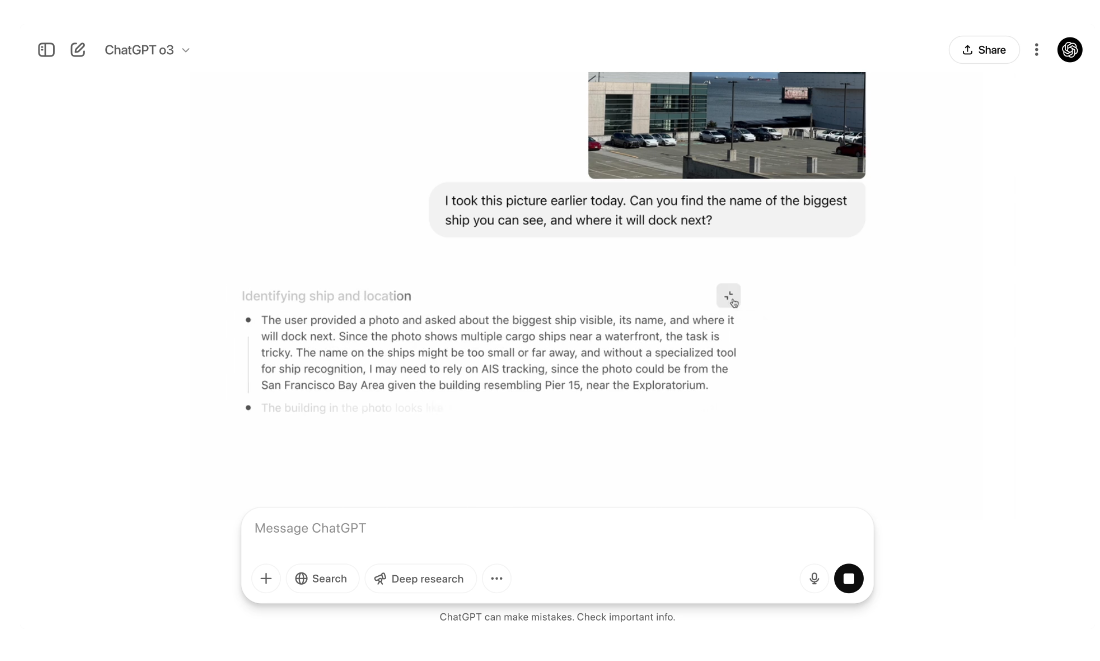

OpenAI har nyligen presenterat en banbrytande uppdatering av sina AI-modeller med lanseringen av o3 och o4-mini, som för första gången kan ”tänka med bilder”. Detta innebär att modellerna inte bara kan tolka visuellt innehåll, utan även integrera det direkt i sin resonemangskedja för att lösa komplexa uppgifter som kombinerar text och bild.

Traditionella AI-modeller kan analysera bilder och ge svar baserat på dem, men o3 och o4-mini tar detta ett steg längre genom att aktivt manipulera bilder under sin analys. De kan exempelvis rotera, zooma in eller beskära bilder för att bättre förstå innehållet. Detta gör det möjligt för modellerna att hantera bilder av låg kvalitet, handskrivna anteckningar eller komplexa diagram med större precision.

Med dessa förbättringar kan användare:

- Ladda upp foton av handskrivna anteckningar eller whiteboardbilder för att få dem tolkade.

- Få hjälp med att lösa matematiska problem genom att analysera bilder av uppgifterna.

- Analysera och förstå komplexa diagram eller tekniska ritningar.

Dessa funktioner är särskilt användbara inom utbildning, teknik och forskning, där visuell information ofta är central.

Modellerna o3 och o4-mini är designade för att fungera sömlöst med andra verktyg inom ChatGPT, såsom webbsökning, kodtolkning och bildgenerering. Detta möjliggör en mer omfattande och kontextuell förståelse av användarens frågor och behov.

Dessa nya funktioner är tillgängliga för användare av ChatGPT Plus, Pro och Team. OpenAI planerar även att lansera en mer avancerad version, o3-pro, inom kort.

För mer information och för att prova dessa funktioner, besök OpenAI:s officiella sida: Thinking with images.